Nova legislação europeia da inteligência artificial “tem um efeito comparável ao RGPD”

A Comissão Europeia apresentou no mês passado aquele que é o primeiro quadro jurídico de sempre relativo à Inteligência Artificial (IA), propondo um regulamento – que ainda requer aprovação do Parlamento Europeu e do Conselho – com base no risco que a tecnologia pode representar: inaceitável, elevado, limitado e mínimo.

Para o professor Luís Barreto Xavier, como uma das prioridades de Bruxelas é preparar a União Europeia (UE) para a era digital e para a concorrência tecnológica da China e dos Estados Unidos, o domínio da Inteligência Artificial (IA) é o elemento central nesta estratégia, porque é transversal a todos os sectores da economia e tem um impacto muito transformador nas empresas e consumidores (mais do que outra qualquer tecnologia). Daí estar previsto um investimento anual da Comissão Europeia de mil milhões de euros em IA, no âmbito dos programas Europa Digital e Horizonte Europe.

“Este regulamento vai ter um efeito comparável ao Regulamento Geral da Proteção de Dados [RGDP] do ponto de vista do impacto extra-europeu para as empresas, apesar de ser um regulamento europeu, aplicável pelos Estados-membros e pelos órgãos da UE. As coimas previstas são também pesadíssimas”, refere o docente da Faculdade de Direito da Universidade Católica Portuguesa ao Jornal Económico (JE).

Aliás, a proposta de legislação prevê que, tal como no RGPD, cada país designe uma autoridade para promover a aplicação do regulamento. Questionado sobre que entidade poderá assumir essa pasta em Portugal, Luís Barreto Xavier diz que “ainda é cedo para antecipar”. “Está em aberto a opção entre atribuir estas competências a uma entidade já existente ou criar uma própria para este efeito”, acrescenta.

Na prática, o regulamento estabelece que as ferramentas tecnológicas que ponham em causa a segurança e os direitos fundamentais das pessoas, como por exemplo brinquedos capazes de manipular negativamente o comportamento de crianças ou sistemas de ranking de cidadãos em função daquilo que fazem, são consideradas como tendo um risco inaceitável e não podem ser utilizados na UE.

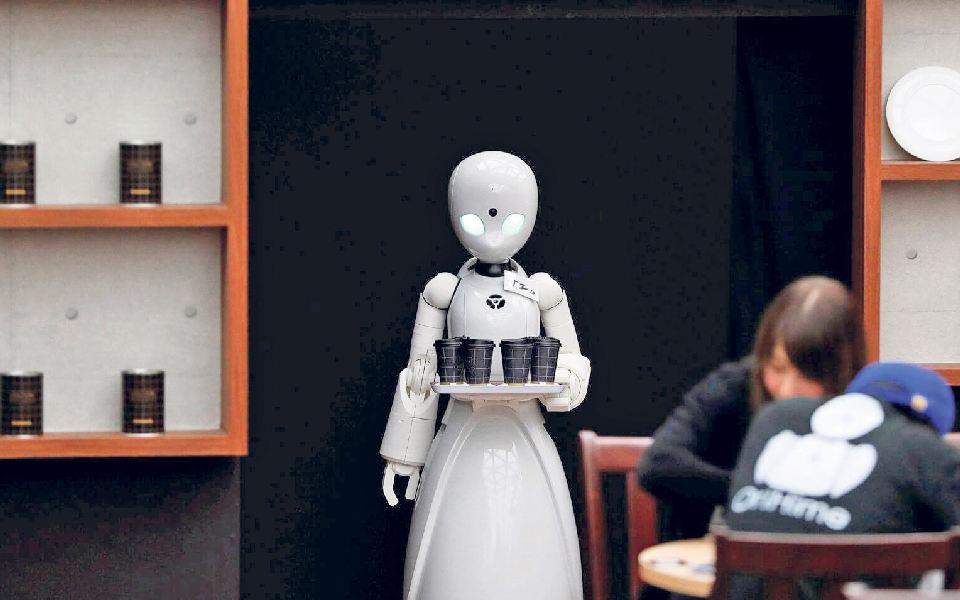

Já o alto risco está inerente a casos/áreas como o ensino e a formação profissional (classificação de exames, entre outros) que possam determinar o acesso ao ensino ou a carreira profissional de alguém ou componentes de segurança dos produtos, onde se insere a aplicação de IA em cirurgia assistida por robôs. “Basta pensar na utilização de algoritmos para efeitos de recrutamento ou diagnósticos médicos. Ou seja, apesar de existirem requisitos de natureza sectorial, aqui acrescenta-se mais uma camada regulatória para prevenir danos e proporcionar confiança ao público”, exemplifica.

Por fim, no terceiro e quarto nível da tabela, quando a UE fala em sistemas tecnológicos de menor risco refere-se aos já tradicionais automatismos para filtrar spam no email ou chatbots, que só estão sujeitos a requisitos de transparência: i.e. as pessoas têm de saber que estão a falar com uma máquina. O objetivo de todos estes parâmetros é que o uso da IA na Europa seja segura, transparente, ética, imparcial e esteja sob o controlo humano. “É um esforço muito ambicioso da Comissão Europeia. É a primeira vez que, a nível mundial, se tenta regular transversalmente os sistemas de IA. Não se regula a tecnologia como tal mas os seus usos”, afirma o jurista ao JE.

Na sua opinião, é expectável que esta proposta de legislação seja fundamentalmente a base do texto final que será aprovado, mas deverá haver alterações. “Até porque neste processo vai haver muita tentativa de lóbi, dado o impacto brutal não apenas nas Big Tech, que hoje se alcandoraram ao papel das maiores empresas mundiais, mas também em todas as outras que utilizam este tipo de tecnologias e operam no mercado europeu ou em querem operar”, explica o consultor da Abreu Advogados. “E há um aspeto que convém referir: a aprovação é demorada e complicada, pela intervenção de diferentes órgãos europeus que implica, e há um risco de cristalização. Sabemos que as tecnologias evoluem muito rapidamente mas a Comissão pensou nisso e há possibilidade de os anexos serem alterados de uma forma mais flexível”, detalha ao JE.

RECOMENDADO

Tagus Park – Edifício Tecnologia 4.1

Avenida Professor Doutor Cavaco Silva, nº 71 a 74

2740-122 – Porto Salvo, Portugal

online@medianove.com